Στον συνεχώς εξελισσόμενο κόσμο της τεχνητής νοημοσύνης, ο γρήγορος ρυθμός της αλλαγής εξασφαλίζει ότι υπάρχουν πάντα νέες εξελίξεις που αναμορφώνουν τη βιομηχανία. Η πρόσφατη κυκλοφορία του μοντέλου συλλογισμού R1 είναι η τελευταία εξέλιξη για την αποστολή σοκ σε όλο τον τομέα, ιδιαίτερα στον τομέα των μεγάλων γλωσσικών μοντέλων (LLMS).

Η υπόσχεση χαμηλού κόστους και υψηλής απόδοσης έχει δώσει τη θέση της στην αβεβαιότητα και τη σύγχυση σε μια αγορά μόλις μονοπωλεί από προγραμματιστές με βαθιές τσέπες που θα μπορούσαν να χρηματοδοτήσουν ακριβό εξοπλισμό όπως οι GPU. Αυτή η μετατόπιση οδηγεί σε ορατές απώλειες για εταιρείες που εκτίθενται στη βιομηχανία κέντρων δεδομένων. Η GPU GIANT NVIDIA οδηγεί σε αυτές τις απώλειες, καθώς οι επενδυτές επαναξιολογούν εάν μπορεί να κερδίσει δισεκατομμύρια εάν τα μοντέλα AI μπορούν να αναπτυχθούν με ένα κλάσμα προηγούμενων εκτιμήσεων κόστους. Άλλοι, συμπεριλαμβανομένων των meta και openai, επανεξετάζουν την τεχνική τους αντοχή στην ανάπτυξη λογισμικού AI.

Σε αυτό το άρθρο, θα διερευνήσουμε την τροχιά του LLMS, την επίδραση αυτής της επανάστασης και τις πιθανές μελλοντικές κατευθύνσεις για τον τομέα.

Ένα παιχνίδι αλλαγής παιχνιδιού σε οικονομικά αποδοτικό AI

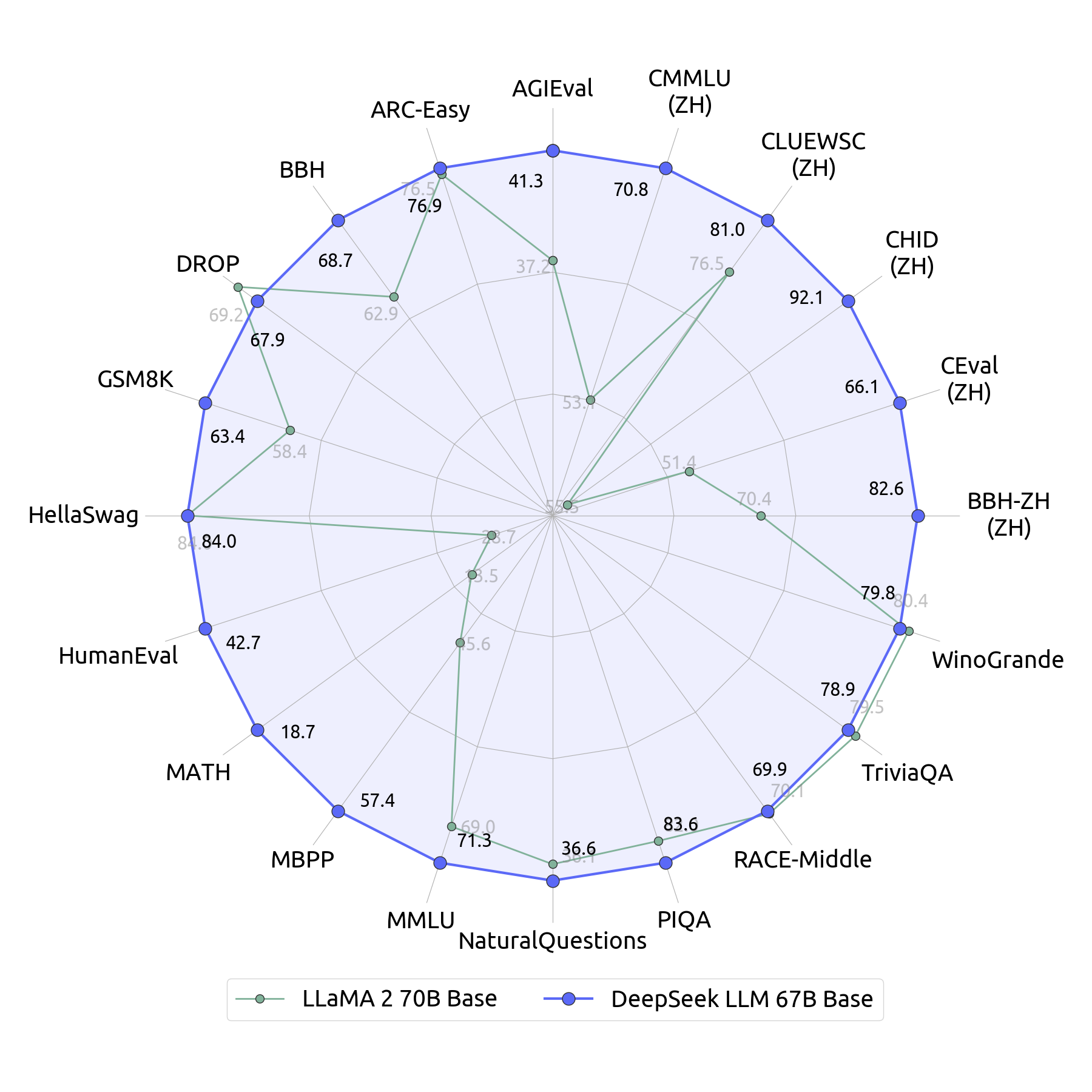

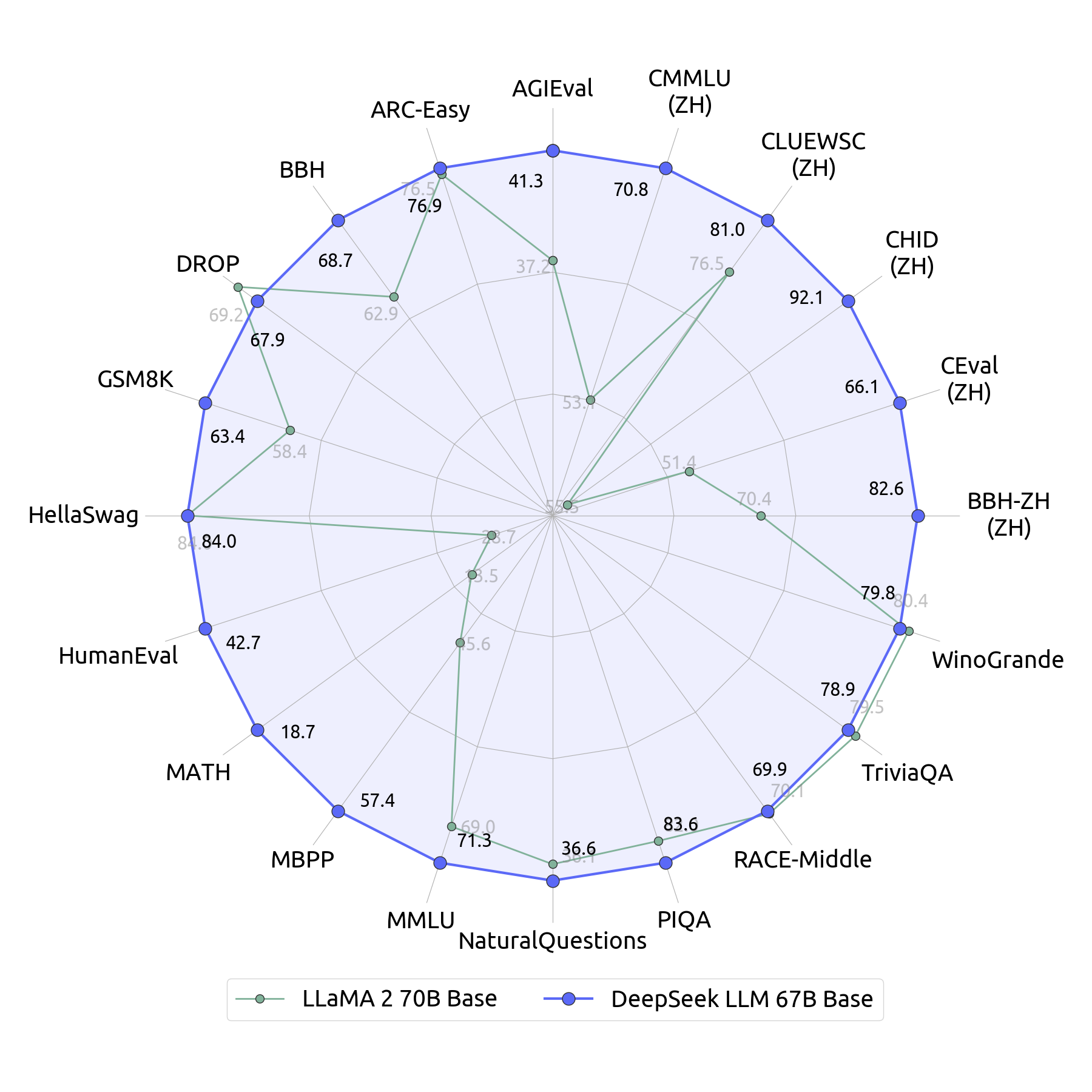

Το μοντέλο λογικής Deepseek R1 δεν ταιριάζει μόνο με την απόδοση των κορυφαίων μοντέλων όπως το O1 της Openai, αλλά το κάνει με αξιοσημείωτη απόδοση κόστους. Ενώ τα στοιχεία του Deepseek μπορεί να φαίνονται πολύ καλά για να είναι αληθινά, οι εξελίξεις στις μεθόδους κατάρτισης και συμπερασμάτων ωθούν ωστόσο τα σύνορα της ανάπτυξης του μοντέλου AI, επιτρέποντας συγκρίσιμα αποτελέσματα σε ένα κλάσμα του αναπτυξιακού και λειτουργικού κόστους.

Το Deepseek-R1 έχει αποδείξει ότι είναι δυνατόν να επιτευχθούν δεξιότητες συλλογιστικής στο ίδιο επίπεδο με το O1 του Openai χωρίς να ξεκινάει με εποπτευόμενη τελειοποίηση. Το μοντέλο χρησιμοποιεί μια αρχιτεκτονική μείγματος (MOE) (εξηγείται αργότερα), η οποία ενεργοποιεί 37 δισεκατομμύρια παραμέτρους από 671 δισεκατομμύρια.

Εντυπωσιακά, σημείωσε το 79,8% στις εξετάσεις AIME 2024, ταιριάζοντας με την απόδοση του O1. Η διαδικασία κατάρτισης συνδυάζει την καθαρή μάθηση ενίσχυσης (Deepseek-R1-Zero) με τα αρχικά δεδομένα και την επαναληπτική τελειοποίηση. Αυτή η προσέγγιση επιτρέπει την ανάπτυξη του καταναλωτικού υλικού μέσω μικρότερων, αποσταγμένων εκδόσεων – μερικές με λίγες παράμετροι 1,5 δισεκατομμυρίων.

Καινοτόμος προσέγγιση κατάρτισης

Το χαρακτηριστικό γνώρισμα του Deepseek-R1 είναι η μοναδική μεθοδολογία κατάρτισης. Σε αντίθεση με τα παραδοσιακά μοντέλα που βασίζονται σε μεγάλο βαθμό στην εποπτευόμενη μάθηση με εκτεταμένα ετικέτες σύνολα δεδομένων, η Deepseek-R1 αναπτύχθηκε χρησιμοποιώντας μια πρώτη προσέγγιση ενισχυτικής μάθησης (RL).

Αυτό σημαίνει ότι το μοντέλο έμαθε δεξιότητες συλλογισμού μέσω δοκιμών και σφάλματος, χωρίς αρχικά παραδείγματα που παρέχονται από τον άνθρωπο. Αυτή η RL-κεντρική κατάρτιση της επέτρεψε να αναπτύξει αυτόνομα στρατηγικές επίλυσης προβλημάτων, οδηγώντας σε εντυπωσιακές επιδόσεις σε σημεία αναφοράς.

Οι βασικοί παράγοντες της επιτυχίας για αυτό το μοντέλο είναι οι προσεγγίσεις που έγιναν για την κατάρτιση:

- Τελειοποιώντας ένα προ-εκπαιδευμένο μοντέλο: Το R1 ξεκινά με ένα μοντέλο θεμελίωσης, πιθανώς εκπαιδευμένο σε μαζικά σύνολα δεδομένων κειμένου και κώδικα.

- Ανθρώπινα σχόλια: Οι ανθρώπινοι εμπειρογνώμονες παρέχουν ανατροφοδότηση σχετικά με τις εξόδους του μοντέλου, καθοδηγώντας τις πιο ακριβείς και χρήσιμες απαντήσεις.

- Ενίσχυση μάθησης: Το μοντέλο στη συνέχεια ρυθμίζεται με τη χρήση αλγορίθμων μάθησης ενίσχυσης. Αυτή η διαδικασία ανταμείβει το μοντέλο για την παραγωγή εξόδων που ευθυγραμμίζονται με τις ανθρώπινες προτιμήσεις και το τιμωρεί για ανεπιθύμητες εξόδους.

Αυτή η επαναληπτική διαδικασία επιτρέπει στο R1 να μάθει και να βελτιώσει τις ικανότητές του με βάση την ανθρώπινη ανατροφοδότηση, με αποτέλεσμα αξιοσημείωτες βελτιώσεις στις δεξιότητές του για τη συλλογιστική και την επίλυση προβλημάτων.

Deepseek-V3 και αυτό που υπονοεί για τους λογικούς AI

Το τελευταίο μοντέλο του Deepseek, Deepseek-V3, βασίζεται στο ίδρυμα που έθεσε ο προκάτοχός του, Deepseek-R1. Το μοντέλο V3 εισάγει αρκετές τεχνικές καινοτομίες που ενισχύουν την απόδοση, την αποτελεσματικότητα και την προσβασιμότητα.

Τεχνικές καινοτομίες στο Deepseek-V3

- Αρχιτεκτονική του μείγματος των ειδών (MOE): Το Deepseek-V3 χρησιμοποιεί ένα πλαίσιο μείγματος-εμπειρογνωμόνων που αποτελείται από πολλαπλά εξειδικευμένα νευρωνικά δίκτυα, κάθε βελτιστοποιημένο για συγκεκριμένες εργασίες. Ένας μηχανισμός δρομολόγησης κατευθύνει τις εισροές στον καταλληλότερο εμπειρογνώμονα, επιτρέποντας στο μοντέλο να χειρίζεται αποτελεσματικά διαφορετικά καθήκοντα. Αυτή η επιλεκτική ενεργοποίηση μειώνει τα υπολογιστικά γενικά έξοδα και επιταχύνει την επεξεργασία.

- Πρόβλεψη πολλαπλών τερματοφύλακα (MTP): Σε αντίθεση με τα παραδοσιακά μοντέλα που παράγουν κείμενο ένα διακριτικό κάθε φορά, το Deepseek-V3 μπορεί να προβλέψει ταυτόχρονα πολλαπλά μάρκες. Αυτή η δυνατότητα επιταχύνει τη διαδικασία συμπερασμάτων και βελτιώνει την ικανότητα του μοντέλου να δημιουργεί συνεκτικό, σχετικό κείμενο.

- FP8 μικτή εκπαίδευση ακριβείας: Το μοντέλο αξιοποιεί ένα πλαίσιο κατάρτισης ακριβείας FP8, χρησιμοποιώντας αριθμούς κυμαινόμενου σημείου 8-bit. Αυτή η προσέγγιση μειώνει τη χρήση της μνήμης και επιταχύνει τους υπολογισμούς χωρίς να θέτει σε κίνδυνο την ακρίβεια, ενισχύοντας τη σχέση κόστους-αποτελεσματικότητας του μοντέλου.

Παρακάμπτοντας τους περιορισμούς υλικού με PTX

Απαντώντας στους ελέγχους εξαγωγής των ΗΠΑ που περιορίζουν την πρόσβαση σε GPU υψηλής ποιότητας όπως το H800 της NVIDIA, η Deepseek υιοθέτησε καινοτόμες στρατηγικές για να ξεπεράσει τους περιορισμούς του υλικού. Με την αξιοποίηση της ενδιάμεσης αναπαράστασης της παράλληλης εκτέλεσης νήματος της Nvidia (PTX), η DeepSeek βελτιστοποίησε το μοντέλο της για να τρέξει αποτελεσματικά σε διαθέσιμο υλικό, εξασφαλίζοντας υψηλή απόδοση παρά τους περιορισμούς.

Το PTX επιτρέπει τον λεπτό έλεγχο των λειτουργιών GPU, επιτρέποντας στους προγραμματιστές να μεγιστοποιούν την απόδοση και τη χρήση του εύρους ζώνης μνήμης. Αυτή η προσέγγιση επέτρεψε στο Deepseek να επιτύχει υψηλή απόδοση παρά τους περιορισμούς υλικού.

Janus Pro: Επαναπροσδιορισμός της αποτελεσματικότητας στο Multimodal LLM

Η Deepseek έχει εδραιώσει περαιτέρω τη θέση του ως ηγέτη στο χώρο AI με την απελευθέρωση του Janus Pro-7B, ενός συμπαγούς αλλά ισχυρού μοντέλου παραμέτρων 7 δισεκατομμυρίων. Αυτό το μοντέλο αποτελεί παράδειγμα της μετατόπισης προς τη δημιουργία μικρότερων, πιο αποτελεσματικών μεγάλων γλωσσικών μοντέλων χωρίς να θυσιάζουν την απόδοση.

Βασικά χαρακτηριστικά του Janus pro-7b

- Ελαφρύ και προσβάσιμο **: Ο Janus Pro-7B επιτυγχάνει ισορροπία μεταξύ του μεγέθους του μοντέλου και της απόδοσης, καθιστώντας την εξαιρετικά αποτελεσματική για ανάπτυξη σε υλικό καταναλωτών. Η συμπαγής αρχιτεκτονική του προωθεί την ευρύτερη προσβασιμότητα, εξασφαλίζοντας ότι ακόμη και οι μικρότεροι οργανισμοί μπορούν να αξιοποιήσουν τις προχωρημένες δυνατότητες AI.

- Επάρκεια πολλαπλών στοιχείων: Παρά το μικρότερο μέγεθος του, ο Janus Pro-7B επιδεικνύει ισχυρή επάρκεια σε διαφορετικά καθήκοντα, συμπεριλαμβανομένης της συλλογιστικής, της δημιουργίας περιεχομένου και της εξειδικευμένης επίλυσης προβλημάτων. Αυτή η ευελιξία καθιστά μια βιώσιμη επιλογή για διάφορες περιπτώσεις χρήσης σε διαφορετικές βιομηχανίες.

- Αποδοτικότητα κατάρτισης: Το μοντέλο ήταν τελειοποιημένο χρησιμοποιώντας προηγμένες τεχνικές μάθησης ενίσχυσης, ενσωματώνοντας την ανθρώπινη ανατροφοδότηση (RLHF) για ακριβή παραγωγή εξόδου. Αυτή η μέθοδος διασφαλίζει την απόδοση υψηλής ποιότητας χωρίς τα υπολογιστικά έξοδα που σχετίζονται με μεγαλύτερα μοντέλα.

- Ανοικτή πρόσβαση: Το Janus Pro-7B είναι ανοιχτό και διαθέσιμο στο Face Hugging, προωθώντας τη συνεργασία μέσα στην κοινότητα AI. Η διαθεσιμότητά του ενθαρρύνει την καινοτομία παρέχοντας στους προγραμματιστές και τους ερευνητές ένα μοντέλο τελευταίας τεχνολογίας για πειραματισμό και ανάπτυξη.

Επιπτώσεις για τη βιομηχανία

Το Janus Pro-7B υπογραμμίζει την τάση προς τα συμπαγή, συγκεκριμένα μοντέλα AI που δίνουν προτεραιότητα στην απόδοση. Καθώς οι εταιρείες επιδιώκουν να ενσωματώσουν το AI σε περιβάλλοντα περιορισμένου πόρων, μοντέλα όπως το Janus Pro-7B πιθανότατα θα διαδραματίσουν κρίσιμο ρόλο στην οδήγηση υιοθεσίας και καινοτομίας.

Αυτή η εξέλιξη ευθυγραμμίζεται με το ευρύτερο όραμα της Deepseek για τον εκδημοκρατισμό του AI συνδυάζοντας υψηλή απόδοση με την προσβασιμότητα, εξασφαλίζοντας ότι η τεχνολογία αιχμής είναι διαθέσιμη σε ένα ευρύτερο κοινό.

Το μέλλον του LLMS

Η επιτυχία του Deepseek R1 με το RLHF ανοίγει το δρόμο για μελλοντικές εξελίξεις στο LLMS κατά μήκος αρκετών τροχιών:

- Πιο εξελιγμένα μοντέλα: Περιμένετε LLM με ακόμη μεγαλύτερες δυνατότητες συλλογιστικής και επίλυσης προβλημάτων.

- Εξατομικευμένα μοντέλα: Μοντέλα προσαρμοσμένα σε μεμονωμένες προτιμήσεις και ανάγκες των χρηστών.

- Βελτιστοποίηση υλικού: Καθώς οι περιορισμοί υλικού παραμένουν, η βελτιστοποίηση των μοντέλων για την αποτελεσματική λειτουργία των διαθέσιμων πόρων θα είναι απαραίτητη. Τεχνικές όπως η αξιοποίηση των ενδιάμεσων αναπαραστάσεων όπως το PTX θα είναι πιθανώς ζωτικής σημασίας.

- Αυξημένη αποτελεσματικότητα: Οι καινοτομίες όπως οι αρχιτεκτονικές MOE και η μικτή κατάρτιση ακριβείας είναι έτοιμες να γίνουν πιο διαδεδομένες, επιτρέποντας ισχυρά μοντέλα με μειωμένες υπολογιστικές απαιτήσεις.

- Νέες εφαρμογές: Τα LLMs εφαρμόζονται σε ένα ευρύτερο φάσμα πεδίων, συμπεριλαμβανομένης της υγειονομικής περίθαλψης, της εκπαίδευσης και της χρηματοδότησης.

- Συνεργασία ανοικτού κώδικα: Η φύση ανοιχτού κώδικα των μοντέλων όπως το DeepSeek-V3 προάγει τη συνεργασία και επιταχύνει την καινοτομία, υποδηλώνοντας ένα μέλλον με περισσότερη ανάπτυξη της AI που βασίζεται στην κοινότητα.

Συνολικά, αυτή η έκδοση αντιπροσωπεύει μια σημαντική μετατόπιση στον αγώνα AI. Μέχρι τώρα, οι Ηνωμένες Πολιτείες ήταν ο κυρίαρχος παίκτης, αλλά η Κίνα έχει εισέλθει στον διαγωνισμό με ένα κτύπημα τόσο σημαντικό που δημιούργησε ένα ποσό τρισεκατομμυρίων δολαρίων στην αγορά. Ωστόσο, οι περισσότεροι ανταγωνιστές παραμένουν αισιόδοξοι, θεωρώντας το ως οπισθοδρόμηση και όχι ως τέλος. Για τους τελικούς χρήστες, ο διαγωνισμός αυτός υπόσχεται καλύτερα μοντέλα σε φθηνότερες τιμές, τελικά προωθώντας ακόμη μεγαλύτερη καινοτομία.

VIA: wccftech.com

Στον συνεχώς εξελισσόμενο κόσμο της τεχνητής νοημοσύνης, ο γρήγορος ρυθμός της αλλαγής εξασφαλίζει ότι υπάρχουν πάντα νέες εξελίξεις που αναμορφώνουν τη βιομηχανία. Η πρόσφατη κυκλοφορία του μοντέλου συλλογισμού R1 είναι η τελευταία εξέλιξη για την αποστολή σοκ σε όλο τον τομέα, ιδιαίτερα στον τομέα των μεγάλων γλωσσικών μοντέλων (LLMS).

Η υπόσχεση χαμηλού κόστους και υψηλής απόδοσης έχει δώσει τη θέση της στην αβεβαιότητα και τη σύγχυση σε μια αγορά μόλις μονοπωλεί από προγραμματιστές με βαθιές τσέπες που θα μπορούσαν να χρηματοδοτήσουν ακριβό εξοπλισμό όπως οι GPU. Αυτή η μετατόπιση οδηγεί σε ορατές απώλειες για εταιρείες που εκτίθενται στη βιομηχανία κέντρων δεδομένων. Η GPU GIANT NVIDIA οδηγεί σε αυτές τις απώλειες, καθώς οι επενδυτές επαναξιολογούν εάν μπορεί να κερδίσει δισεκατομμύρια εάν τα μοντέλα AI μπορούν να αναπτυχθούν με ένα κλάσμα προηγούμενων εκτιμήσεων κόστους. Άλλοι, συμπεριλαμβανομένων των meta και openai, επανεξετάζουν την τεχνική τους αντοχή στην ανάπτυξη λογισμικού AI.

Σε αυτό το άρθρο, θα διερευνήσουμε την τροχιά του LLMS, την επίδραση αυτής της επανάστασης και τις πιθανές μελλοντικές κατευθύνσεις για τον τομέα.

Ένα παιχνίδι αλλαγής παιχνιδιού σε οικονομικά αποδοτικό AI

Το μοντέλο λογικής Deepseek R1 δεν ταιριάζει μόνο με την απόδοση των κορυφαίων μοντέλων όπως το O1 της Openai, αλλά το κάνει με αξιοσημείωτη απόδοση κόστους. Ενώ τα στοιχεία του Deepseek μπορεί να φαίνονται πολύ καλά για να είναι αληθινά, οι εξελίξεις στις μεθόδους κατάρτισης και συμπερασμάτων ωθούν ωστόσο τα σύνορα της ανάπτυξης του μοντέλου AI, επιτρέποντας συγκρίσιμα αποτελέσματα σε ένα κλάσμα του αναπτυξιακού και λειτουργικού κόστους.

Το Deepseek-R1 έχει αποδείξει ότι είναι δυνατόν να επιτευχθούν δεξιότητες συλλογιστικής στο ίδιο επίπεδο με το O1 του Openai χωρίς να ξεκινάει με εποπτευόμενη τελειοποίηση. Το μοντέλο χρησιμοποιεί μια αρχιτεκτονική μείγματος (MOE) (εξηγείται αργότερα), η οποία ενεργοποιεί 37 δισεκατομμύρια παραμέτρους από 671 δισεκατομμύρια.

Εντυπωσιακά, σημείωσε το 79,8% στις εξετάσεις AIME 2024, ταιριάζοντας με την απόδοση του O1. Η διαδικασία κατάρτισης συνδυάζει την καθαρή μάθηση ενίσχυσης (Deepseek-R1-Zero) με τα αρχικά δεδομένα και την επαναληπτική τελειοποίηση. Αυτή η προσέγγιση επιτρέπει την ανάπτυξη του καταναλωτικού υλικού μέσω μικρότερων, αποσταγμένων εκδόσεων – μερικές με λίγες παράμετροι 1,5 δισεκατομμυρίων.

Καινοτόμος προσέγγιση κατάρτισης

Το χαρακτηριστικό γνώρισμα του Deepseek-R1 είναι η μοναδική μεθοδολογία κατάρτισης. Σε αντίθεση με τα παραδοσιακά μοντέλα που βασίζονται σε μεγάλο βαθμό στην εποπτευόμενη μάθηση με εκτεταμένα ετικέτες σύνολα δεδομένων, η Deepseek-R1 αναπτύχθηκε χρησιμοποιώντας μια πρώτη προσέγγιση ενισχυτικής μάθησης (RL).

Αυτό σημαίνει ότι το μοντέλο έμαθε δεξιότητες συλλογισμού μέσω δοκιμών και σφάλματος, χωρίς αρχικά παραδείγματα που παρέχονται από τον άνθρωπο. Αυτή η RL-κεντρική κατάρτιση της επέτρεψε να αναπτύξει αυτόνομα στρατηγικές επίλυσης προβλημάτων, οδηγώντας σε εντυπωσιακές επιδόσεις σε σημεία αναφοράς.

Οι βασικοί παράγοντες της επιτυχίας για αυτό το μοντέλο είναι οι προσεγγίσεις που έγιναν για την κατάρτιση:

- Τελειοποιώντας ένα προ-εκπαιδευμένο μοντέλο: Το R1 ξεκινά με ένα μοντέλο θεμελίωσης, πιθανώς εκπαιδευμένο σε μαζικά σύνολα δεδομένων κειμένου και κώδικα.

- Ανθρώπινα σχόλια: Οι ανθρώπινοι εμπειρογνώμονες παρέχουν ανατροφοδότηση σχετικά με τις εξόδους του μοντέλου, καθοδηγώντας τις πιο ακριβείς και χρήσιμες απαντήσεις.

- Ενίσχυση μάθησης: Το μοντέλο στη συνέχεια ρυθμίζεται με τη χρήση αλγορίθμων μάθησης ενίσχυσης. Αυτή η διαδικασία ανταμείβει το μοντέλο για την παραγωγή εξόδων που ευθυγραμμίζονται με τις ανθρώπινες προτιμήσεις και το τιμωρεί για ανεπιθύμητες εξόδους.

Αυτή η επαναληπτική διαδικασία επιτρέπει στο R1 να μάθει και να βελτιώσει τις ικανότητές του με βάση την ανθρώπινη ανατροφοδότηση, με αποτέλεσμα αξιοσημείωτες βελτιώσεις στις δεξιότητές του για τη συλλογιστική και την επίλυση προβλημάτων.

Deepseek-V3 και αυτό που υπονοεί για τους λογικούς AI

Το τελευταίο μοντέλο του Deepseek, Deepseek-V3, βασίζεται στο ίδρυμα που έθεσε ο προκάτοχός του, Deepseek-R1. Το μοντέλο V3 εισάγει αρκετές τεχνικές καινοτομίες που ενισχύουν την απόδοση, την αποτελεσματικότητα και την προσβασιμότητα.

Τεχνικές καινοτομίες στο Deepseek-V3

- Αρχιτεκτονική του μείγματος των ειδών (MOE): Το Deepseek-V3 χρησιμοποιεί ένα πλαίσιο μείγματος-εμπειρογνωμόνων που αποτελείται από πολλαπλά εξειδικευμένα νευρωνικά δίκτυα, κάθε βελτιστοποιημένο για συγκεκριμένες εργασίες. Ένας μηχανισμός δρομολόγησης κατευθύνει τις εισροές στον καταλληλότερο εμπειρογνώμονα, επιτρέποντας στο μοντέλο να χειρίζεται αποτελεσματικά διαφορετικά καθήκοντα. Αυτή η επιλεκτική ενεργοποίηση μειώνει τα υπολογιστικά γενικά έξοδα και επιταχύνει την επεξεργασία.

- Πρόβλεψη πολλαπλών τερματοφύλακα (MTP): Σε αντίθεση με τα παραδοσιακά μοντέλα που παράγουν κείμενο ένα διακριτικό κάθε φορά, το Deepseek-V3 μπορεί να προβλέψει ταυτόχρονα πολλαπλά μάρκες. Αυτή η δυνατότητα επιταχύνει τη διαδικασία συμπερασμάτων και βελτιώνει την ικανότητα του μοντέλου να δημιουργεί συνεκτικό, σχετικό κείμενο.

- FP8 μικτή εκπαίδευση ακριβείας: Το μοντέλο αξιοποιεί ένα πλαίσιο κατάρτισης ακριβείας FP8, χρησιμοποιώντας αριθμούς κυμαινόμενου σημείου 8-bit. Αυτή η προσέγγιση μειώνει τη χρήση της μνήμης και επιταχύνει τους υπολογισμούς χωρίς να θέτει σε κίνδυνο την ακρίβεια, ενισχύοντας τη σχέση κόστους-αποτελεσματικότητας του μοντέλου.

Παρακάμπτοντας τους περιορισμούς υλικού με PTX

Απαντώντας στους ελέγχους εξαγωγής των ΗΠΑ που περιορίζουν την πρόσβαση σε GPU υψηλής ποιότητας όπως το H800 της NVIDIA, η Deepseek υιοθέτησε καινοτόμες στρατηγικές για να ξεπεράσει τους περιορισμούς του υλικού. Με την αξιοποίηση της ενδιάμεσης αναπαράστασης της παράλληλης εκτέλεσης νήματος της Nvidia (PTX), η DeepSeek βελτιστοποίησε το μοντέλο της για να τρέξει αποτελεσματικά σε διαθέσιμο υλικό, εξασφαλίζοντας υψηλή απόδοση παρά τους περιορισμούς.

Το PTX επιτρέπει τον λεπτό έλεγχο των λειτουργιών GPU, επιτρέποντας στους προγραμματιστές να μεγιστοποιούν την απόδοση και τη χρήση του εύρους ζώνης μνήμης. Αυτή η προσέγγιση επέτρεψε στο Deepseek να επιτύχει υψηλή απόδοση παρά τους περιορισμούς υλικού.

Janus Pro: Επαναπροσδιορισμός της αποτελεσματικότητας στο Multimodal LLM

Η Deepseek έχει εδραιώσει περαιτέρω τη θέση του ως ηγέτη στο χώρο AI με την απελευθέρωση του Janus Pro-7B, ενός συμπαγούς αλλά ισχυρού μοντέλου παραμέτρων 7 δισεκατομμυρίων. Αυτό το μοντέλο αποτελεί παράδειγμα της μετατόπισης προς τη δημιουργία μικρότερων, πιο αποτελεσματικών μεγάλων γλωσσικών μοντέλων χωρίς να θυσιάζουν την απόδοση.

Βασικά χαρακτηριστικά του Janus pro-7b

- Ελαφρύ και προσβάσιμο **: Ο Janus Pro-7B επιτυγχάνει ισορροπία μεταξύ του μεγέθους του μοντέλου και της απόδοσης, καθιστώντας την εξαιρετικά αποτελεσματική για ανάπτυξη σε υλικό καταναλωτών. Η συμπαγής αρχιτεκτονική του προωθεί την ευρύτερη προσβασιμότητα, εξασφαλίζοντας ότι ακόμη και οι μικρότεροι οργανισμοί μπορούν να αξιοποιήσουν τις προχωρημένες δυνατότητες AI.

- Επάρκεια πολλαπλών στοιχείων: Παρά το μικρότερο μέγεθος του, ο Janus Pro-7B επιδεικνύει ισχυρή επάρκεια σε διαφορετικά καθήκοντα, συμπεριλαμβανομένης της συλλογιστικής, της δημιουργίας περιεχομένου και της εξειδικευμένης επίλυσης προβλημάτων. Αυτή η ευελιξία καθιστά μια βιώσιμη επιλογή για διάφορες περιπτώσεις χρήσης σε διαφορετικές βιομηχανίες.

- Αποδοτικότητα κατάρτισης: Το μοντέλο ήταν τελειοποιημένο χρησιμοποιώντας προηγμένες τεχνικές μάθησης ενίσχυσης, ενσωματώνοντας την ανθρώπινη ανατροφοδότηση (RLHF) για ακριβή παραγωγή εξόδου. Αυτή η μέθοδος διασφαλίζει την απόδοση υψηλής ποιότητας χωρίς τα υπολογιστικά έξοδα που σχετίζονται με μεγαλύτερα μοντέλα.

- Ανοικτή πρόσβαση: Το Janus Pro-7B είναι ανοιχτό και διαθέσιμο στο Face Hugging, προωθώντας τη συνεργασία μέσα στην κοινότητα AI. Η διαθεσιμότητά του ενθαρρύνει την καινοτομία παρέχοντας στους προγραμματιστές και τους ερευνητές ένα μοντέλο τελευταίας τεχνολογίας για πειραματισμό και ανάπτυξη.

Επιπτώσεις για τη βιομηχανία

Το Janus Pro-7B υπογραμμίζει την τάση προς τα συμπαγή, συγκεκριμένα μοντέλα AI που δίνουν προτεραιότητα στην απόδοση. Καθώς οι εταιρείες επιδιώκουν να ενσωματώσουν το AI σε περιβάλλοντα περιορισμένου πόρων, μοντέλα όπως το Janus Pro-7B πιθανότατα θα διαδραματίσουν κρίσιμο ρόλο στην οδήγηση υιοθεσίας και καινοτομίας.

Αυτή η εξέλιξη ευθυγραμμίζεται με το ευρύτερο όραμα της Deepseek για τον εκδημοκρατισμό του AI συνδυάζοντας υψηλή απόδοση με την προσβασιμότητα, εξασφαλίζοντας ότι η τεχνολογία αιχμής είναι διαθέσιμη σε ένα ευρύτερο κοινό.

Το μέλλον του LLMS

Η επιτυχία του Deepseek R1 με το RLHF ανοίγει το δρόμο για μελλοντικές εξελίξεις στο LLMS κατά μήκος αρκετών τροχιών:

- Πιο εξελιγμένα μοντέλα: Περιμένετε LLM με ακόμη μεγαλύτερες δυνατότητες συλλογιστικής και επίλυσης προβλημάτων.

- Εξατομικευμένα μοντέλα: Μοντέλα προσαρμοσμένα σε μεμονωμένες προτιμήσεις και ανάγκες των χρηστών.

- Βελτιστοποίηση υλικού: Καθώς οι περιορισμοί υλικού παραμένουν, η βελτιστοποίηση των μοντέλων για την αποτελεσματική λειτουργία των διαθέσιμων πόρων θα είναι απαραίτητη. Τεχνικές όπως η αξιοποίηση των ενδιάμεσων αναπαραστάσεων όπως το PTX θα είναι πιθανώς ζωτικής σημασίας.

- Αυξημένη αποτελεσματικότητα: Οι καινοτομίες όπως οι αρχιτεκτονικές MOE και η μικτή κατάρτιση ακριβείας είναι έτοιμες να γίνουν πιο διαδεδομένες, επιτρέποντας ισχυρά μοντέλα με μειωμένες υπολογιστικές απαιτήσεις.

- Νέες εφαρμογές: Τα LLMs εφαρμόζονται σε ένα ευρύτερο φάσμα πεδίων, συμπεριλαμβανομένης της υγειονομικής περίθαλψης, της εκπαίδευσης και της χρηματοδότησης.

- Συνεργασία ανοικτού κώδικα: Η φύση ανοιχτού κώδικα των μοντέλων όπως το DeepSeek-V3 προάγει τη συνεργασία και επιταχύνει την καινοτομία, υποδηλώνοντας ένα μέλλον με περισσότερη ανάπτυξη της AI που βασίζεται στην κοινότητα.

Συνολικά, αυτή η έκδοση αντιπροσωπεύει μια σημαντική μετατόπιση στον αγώνα AI. Μέχρι τώρα, οι Ηνωμένες Πολιτείες ήταν ο κυρίαρχος παίκτης, αλλά η Κίνα έχει εισέλθει στον διαγωνισμό με ένα κτύπημα τόσο σημαντικό που δημιούργησε ένα ποσό τρισεκατομμυρίων δολαρίων στην αγορά. Ωστόσο, οι περισσότεροι ανταγωνιστές παραμένουν αισιόδοξοι, θεωρώντας το ως οπισθοδρόμηση και όχι ως τέλος. Για τους τελικούς χρήστες, ο διαγωνισμός αυτός υπόσχεται καλύτερα μοντέλα σε φθηνότερες τιμές, τελικά προωθώντας ακόμη μεγαλύτερη καινοτομία.

VIA: Πηγή Άρθρου

Greek Live Channels Όλα τα Ελληνικά κανάλια: Βρίσκεστε μακριά από το σπίτι ή δεν έχετε πρόσβαση σε τηλεόραση; Το IPTV σας επιτρέπει να παρακολουθείτε όλα τα Ελληνικά κανάλια και άλλο περιεχόμενο από οποιαδήποτε συσκευή συνδεδεμένη στο διαδίκτυο. Αν θες πρόσβαση σε όλα τα Ελληνικά κανάλια Πατήστε Εδώ

Ακολουθήστε το TechFreak.GR στο Google News για να μάθετε πρώτοι όλες τις ειδήσεις τεχνολογίας.