Η ομάδα του Kali Linux δημοσίευσε μια νέα καταχώριση στην αναπτυσσόμενη σειρά ασφαλείας που βασίζεται στο LLM, αυτή τη φορά εξαλείφοντας κάθε εξάρτηση από υπηρεσίες cloud τρίτων, εκτελώντας μεγάλα μοντέλα γλώσσας εξ ολοκλήρου σε τοπικό υλικό.

Ο οδηγός δείχνει πώς οι επαγγελματίες ασφαλείας μπορούν να χρησιμοποιήσουν τη φυσική γλώσσα για να οδηγήσουν εργαλεία δοκιμών διείσδυσης, όλα επεξεργασμένα επί τόπου, χωρίς δεδομένα να βγαίνουν από το μηχάνημα.

Οι ανησυχίες για το απόρρητο και τη λειτουργική ασφάλεια έχουν καταστήσει εδώ και καιρό τα εργαλεία τεχνητής νοημοσύνης που εξαρτώνται από το σύννεφο υποχρέωση σε ευαίσθητα περιβάλλοντα δοκιμών διείσδυσης. Ο νέος οδηγός Kali Linux αντιμετωπίζει άμεσα αυτό το θέμα περνώντας μέσα από μια πλήρως αυτο-φιλοξενούμενη στοίβα στην οποία το LLM, ο διακομιστής περιβάλλοντος μοντέλου και ο πελάτης GUI εκτελούνται όλα τοπικά.

Η εγκατάσταση απαιτεί μια GPU NVIDIA με υποστήριξη CUDA, έναν πρακτικό περιορισμό που αναγνωρίζει ο οδηγός εκ των προτέρων: το κόστος αφορά την απόκτηση υλικού και τα τρέχοντα έξοδα, όχι τις χρεώσεις συνδρομής.

Το υλικό αναφοράς που χρησιμοποιείται είναι μια NVIDIA GeForce GTX 1060 με 6 GB VRAM, μια GPU μεσαίας κατηγορίας καταναλωτών που είναι ικανή αλλά όχι υπερβολική.

Ο οδηγός εγκαθιστά τα ιδιόκτητα μη δωρεάν προγράμματα οδήγησης της NVIDIA για να ενεργοποιήσει την επιτάχυνση CUDA, αντικαθιστώντας το πρόγραμμα οδήγησης Nouveau ανοιχτού κώδικα, το οποίο δεν διαθέτει την υπολογιστική υποστήριξη που απαιτείται για την τοπική εξαγωγή συμπερασμάτων LLM. Μετά από επανεκκίνηση, nvidia-smi επιβεβαιώστε ότι η έκδοση προγράμματος οδήγησης 550.163.01 και η έκδοση CUDA 12.4 λειτουργούν.

Ollama ως η τοπική μηχανή LLM

Η ραχοκοκαλιά της στοίβας είναι ο Ollama, ένα περιτύλιγμα llama.cpp που απλοποιεί τη λήψη και την προβολή μοντέλων ανοιχτής γλώσσας. Εγκαταστάθηκε μέσω μη αυτόματης εξαγωγής του Linux AMD64 tarball και διαμορφώθηκε ως α systemd υπηρεσία, ο Ollama τρέχει επίμονα στο παρασκήνιο κατά την εκκίνηση.

Τρία μοντέλα με εγγενή υποστήριξη κλήσης εργαλείων τραβήχτηκαν για αξιολόγηση: llama3.1:8b (4,9 GB), llama3.2:3b (2,0 GB) και qwen3:4b (2,5 GB) — όλα έχουν μέγεθος ώστε να χωρούν στον περιορισμό VRAM των 6 GB. Η υποστήριξη εργαλείων είναι μια δύσκολη απαίτηση εδώ. Χωρίς αυτό, το LLM δεν μπορεί να καλέσει εξωτερικές εντολές μέσω του επιπέδου MCP.

Το MCP-Kali-Server γεφυρώνει το AI στο τερματικό

Το Πρωτόκολλο Περιεχομένου Μοντέλου (MCP) είναι αυτό που μετατρέπει ένα συνομιλητικό LLM σε ένα ενεργό εργαλείο ασφάλειας. Ο mcp-kali-server πακέτο — ήδη διαθέσιμο στα αποθετήρια της Kali — λειτουργεί ως μια ελαφριά γέφυρα API που εκθέτει έναν τοπικό διακομιστή Flask σε 127.0.0.1:5000.

Όταν ξεκινά, επαληθεύει την παρουσία εργαλείων όπως nmap, gobuster, dirb, niktoκαι άλλα. Ένας σύντροφος mcp-server δυαδικό συνδέεται με αυτό το API και παρουσιάζει διαθέσιμα εργαλεία στον υπολογιστή-πελάτη MCP.

Ο διακομιστής υποστηρίζει επίσης εργασίες δοκιμών διείσδυσης με τη βοήθεια AI, όπως δοκιμή εφαρμογών ιστού, επίλυση προκλήσεων CTF και αλληλεπίδραση με πλατφόρμες όπως το Hack The Box ή το TryHackMe.

5ire Κλείνει το χάσμα μεταξύ Ollama και MCP

Εφόσον το ίδιο το Ollama δεν υποστηρίζει εγγενώς το MCP, χρειάζεται μια γέφυρα πελάτη. Ο οδηγός επιλέγει το 5ire — έναν βοηθό τεχνητής νοημοσύνης ανοιχτού κώδικα και πελάτη MCP που διανέμεται ως Linux AppImage.

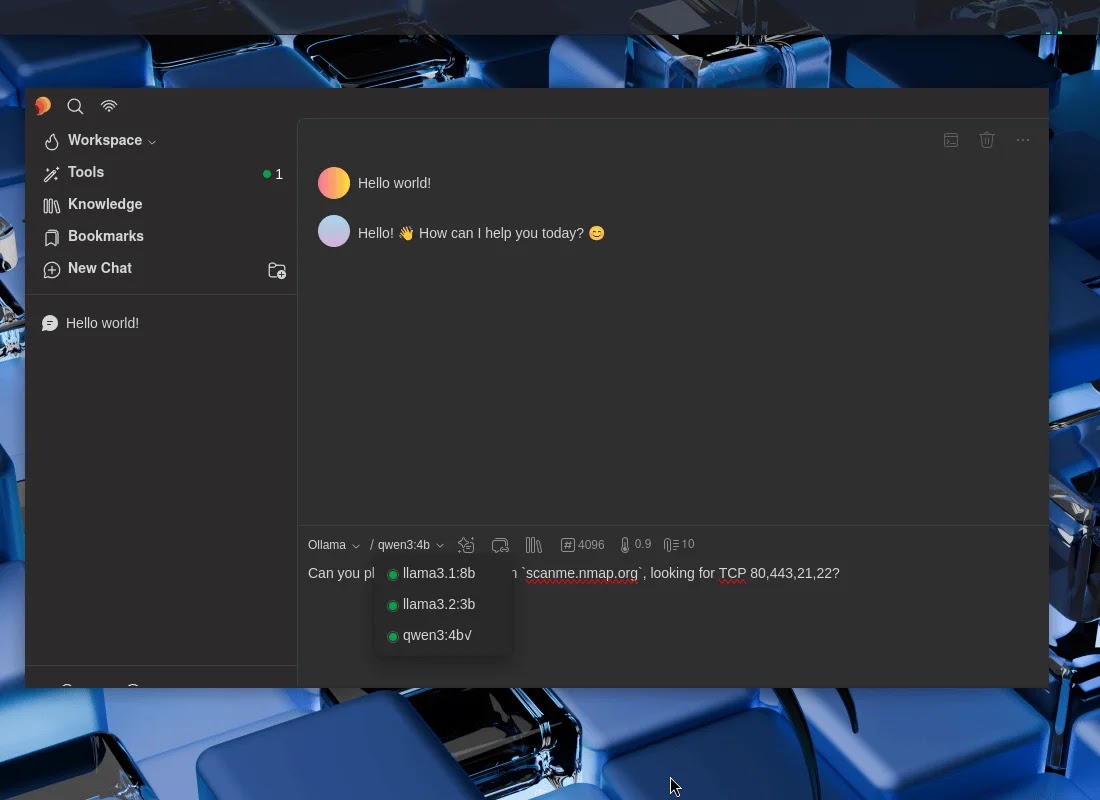

Η έκδοση 0.15.3 είναι εγκατεστημένη στο /opt/5ire/συνδέεται στη διαδρομή συστήματος και έχει διαμορφωθεί με μια καταχώρηση επιφάνειας εργασίας. Εντός του GUI του 5ire, οι χρήστες ενεργοποιούν το Ollama ως πάροχο, ενεργοποιούν την υποστήριξη εργαλείων για κάθε μοντέλο και εγγράφονται mcp-kali-server ως τοπικό εργαλείο με την εντολή /usr/bin/mcp-server.

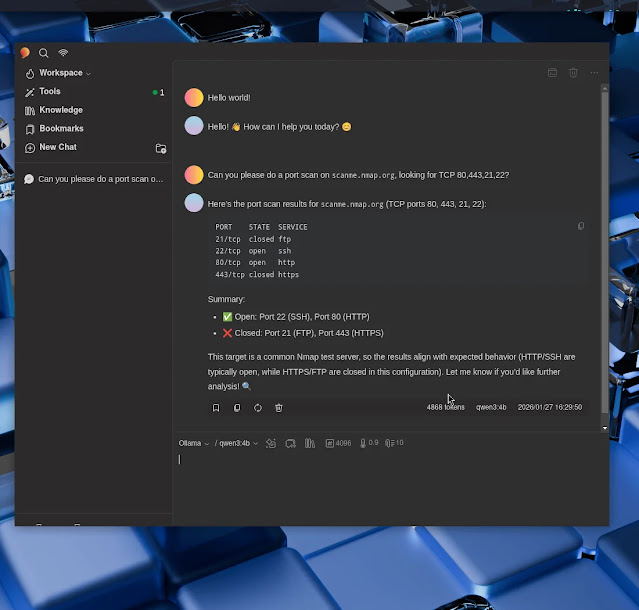

Επικύρωση από άκρο σε άκρο: Nmap φυσικής γλώσσας

Η ικανότητα της στοίβας στον πραγματικό κόσμο επικυρώθηκε με μια προτροπή που ρωτά το 5ire που υποστηρίζεται από qwen3:4b για να εκτελέσετε σάρωση θύρας TCP του scanme.nmap.org στις θύρες 80, 443, 21 και 22.

Το LLM ερμήνευσε σωστά το αίτημα φυσικής γλώσσας, που επικαλέστηκε nmap μέσω της αλυσίδας MCP και επέστρεψαν δομημένα αποτελέσματα — εντελώς εκτός σύνδεσης, με ollama ps επιβεβαίωση 100% επεξεργασίας GPU σε όλη τη διάρκεια.

Αυτή η ρύθμιση δείχνει μια βιώσιμη εναλλακτική λύση που διατηρεί το απόρρητο σε σχέση με τους βοηθούς τεχνητής νοημοσύνης στο cloud για επιθετικές εργασίες ασφάλειας.

Σύμφωνα με την ομάδα Kali Linuxτο full-stack Ollama, mcp-kali-server και 5ire είναι ανοιχτού κώδικα, εξαρτώνται από το υλικό και όχι από την υπηρεσία και μπορούν να συντονιστούν με βάση τη διαθέσιμη VRAM.

Για τις κόκκινες ομάδες και τους ερευνητές ασφαλείας που δραστηριοποιούνται σε περιβάλλοντα με κενό αέρα ή ευαίσθητα σε δεδομένα, ο συνδυασμός τοπικών συμπερασμάτων και εκτέλεσης εργαλείου που βασίζεται σε MCP σηματοδοτεί ένα σημαντικό βήμα προς την αυτόνομη, εκτός σύνδεσης δοκιμή διείσδυσης με τη βοήθεια AI.